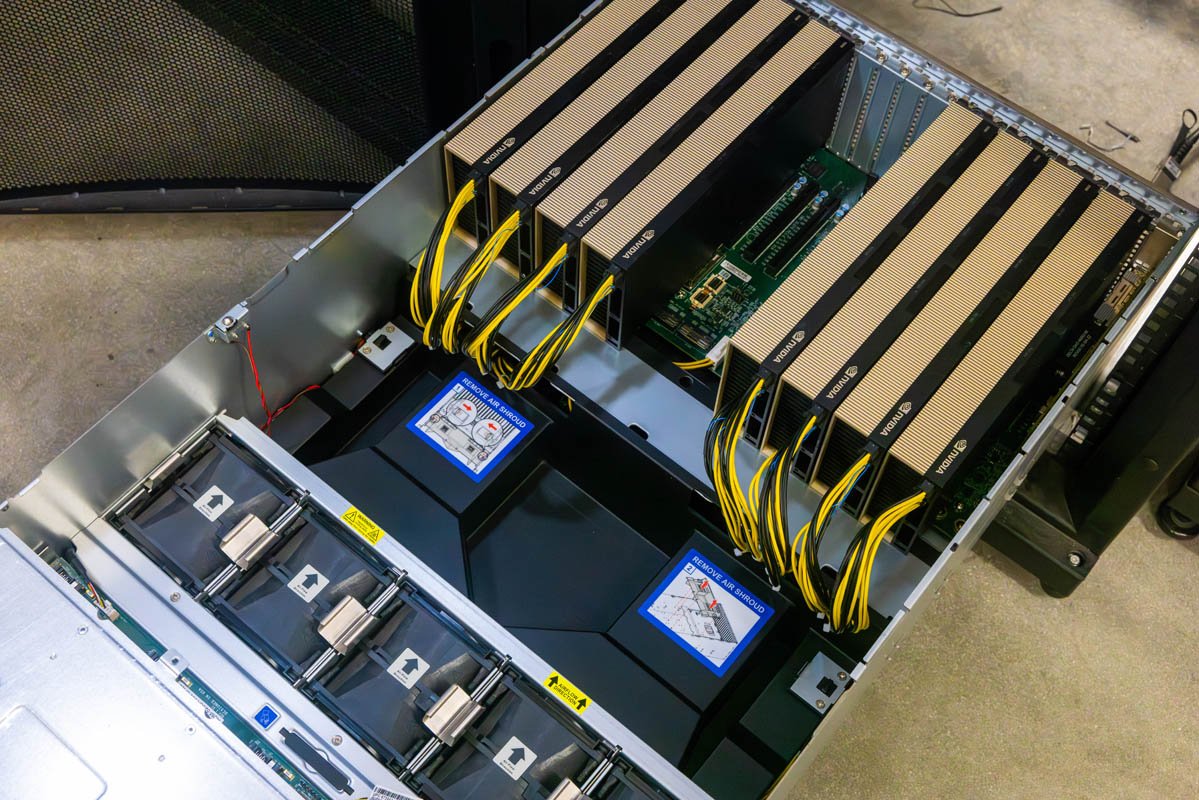

Главное отличие современных систем в том, что они занимают полный 5U-корпус. Как правило, это связано с тем, что TDP каждого графического процессора, H100 или L40S, составляет 350 Вт. Обычно в таких системах восемь графических процессоров, что составляет около 2,8 кВт. Кроме того, эти системы обычно потребляют от 4,3 до 5 кВт. Этого достаточно для одного сервера в стойке на 208 В и 30 А или для нескольких серверов в стойке с более высокой мощностью. С современными серверами для искусственного интеллекта вопрос плотности размещения не так актуален, поскольку зачастую ограничивающими факторами являются мощность и охлаждение в стойках.

Это дополнительное пространство в 1U обеспечивает лучшее охлаждение графических процессоров (GPU). GPU от NVIDIA, такие как H100 и L40S, следуют этому принципу: обычно они могут работать на максимальной заявленной мощности, но в среднем потребляют меньше этого значения.

У компании Supermicro есть версии этого шасси как на базе процессоров Intel Xeon, так и на AMD EPYC. В примере было настроено две версии с Intel Xeon, одна из которых оснащена восемью графическими процессорами NVIDIA H100.

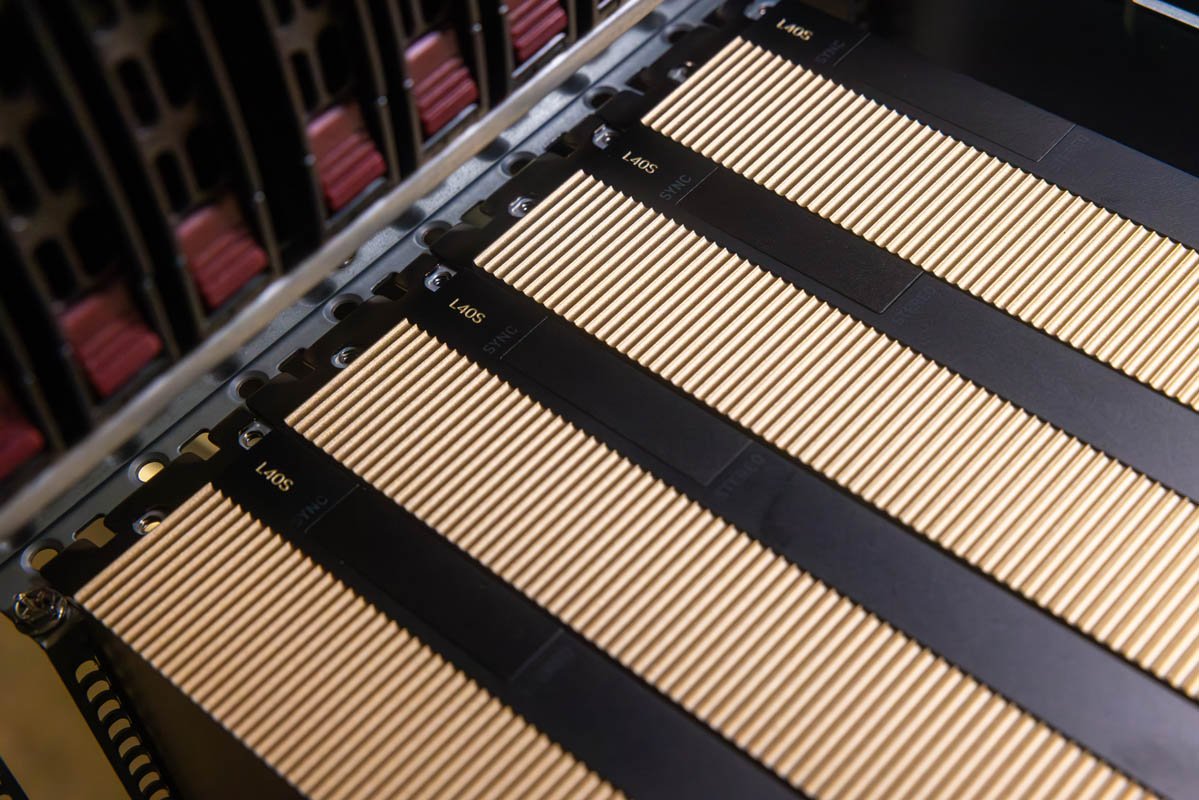

А вторая с картами NVIDIA L40S.

Вы можете видеть, что здесь установлено всего восемь карт, но эти системы масштабируются до десяти.

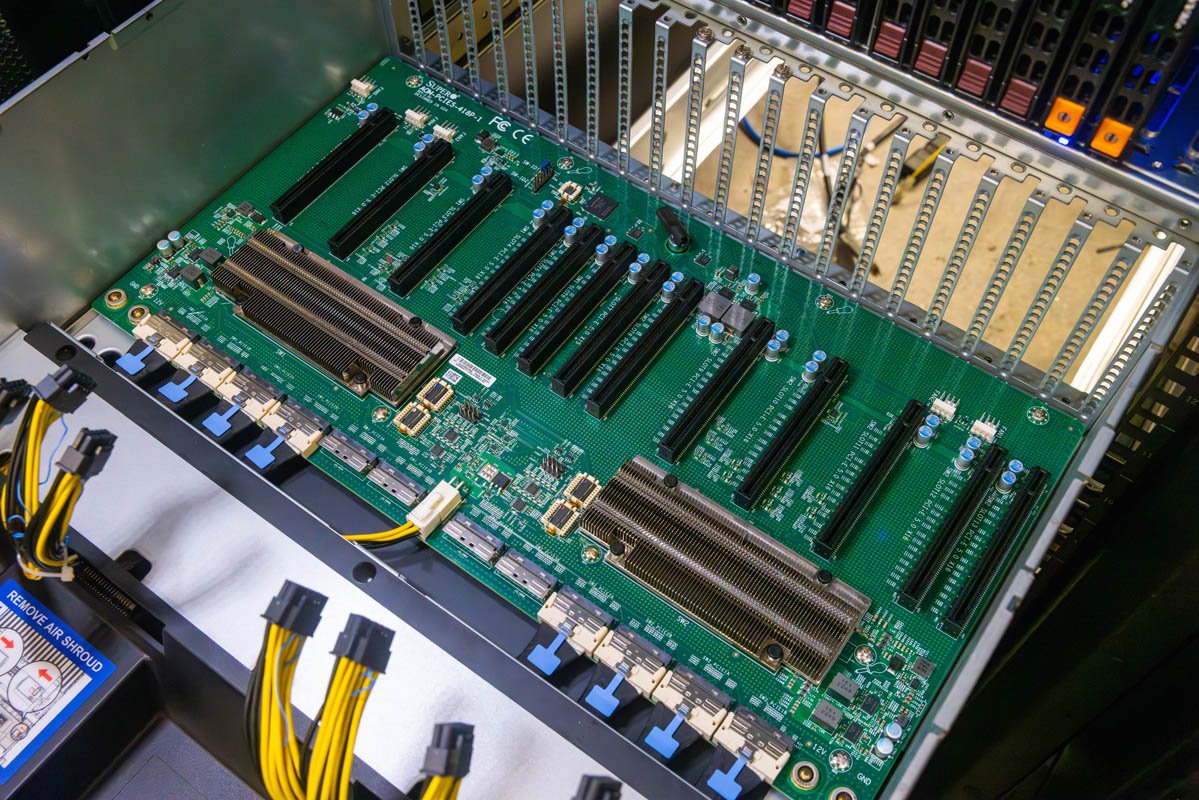

При использовании серверов с GPU на базе PCIe способ их подключения имеет критическое значение для таких функций, как P2P (peer-to-peer) через PCIe-коммутатор без NVLink, а также для эффективности работы NVIDIA NCCL при распределенных вычислениях. NCCL необходим для масштабирования задач на несколько GPU.

Модель Supermicro SYS-521GE-TNRT использует коммутаторы PCIe Gen5 в конфигурации с двумя корневыми комплексами (dual root). На плате GPU под радиаторами можно увидеть два PCIe-коммутатора; сама плата соединена кабелями между этими коммутаторами и центральными процессорами системы.

Ускорители NVIDIA H100 можно установить в этот сервер, соединив их попарно с помощью мостиков NVLink. Что касается L40S, то здесь все работает исключительно через PCIe.

Краткая информация о результатах тестов

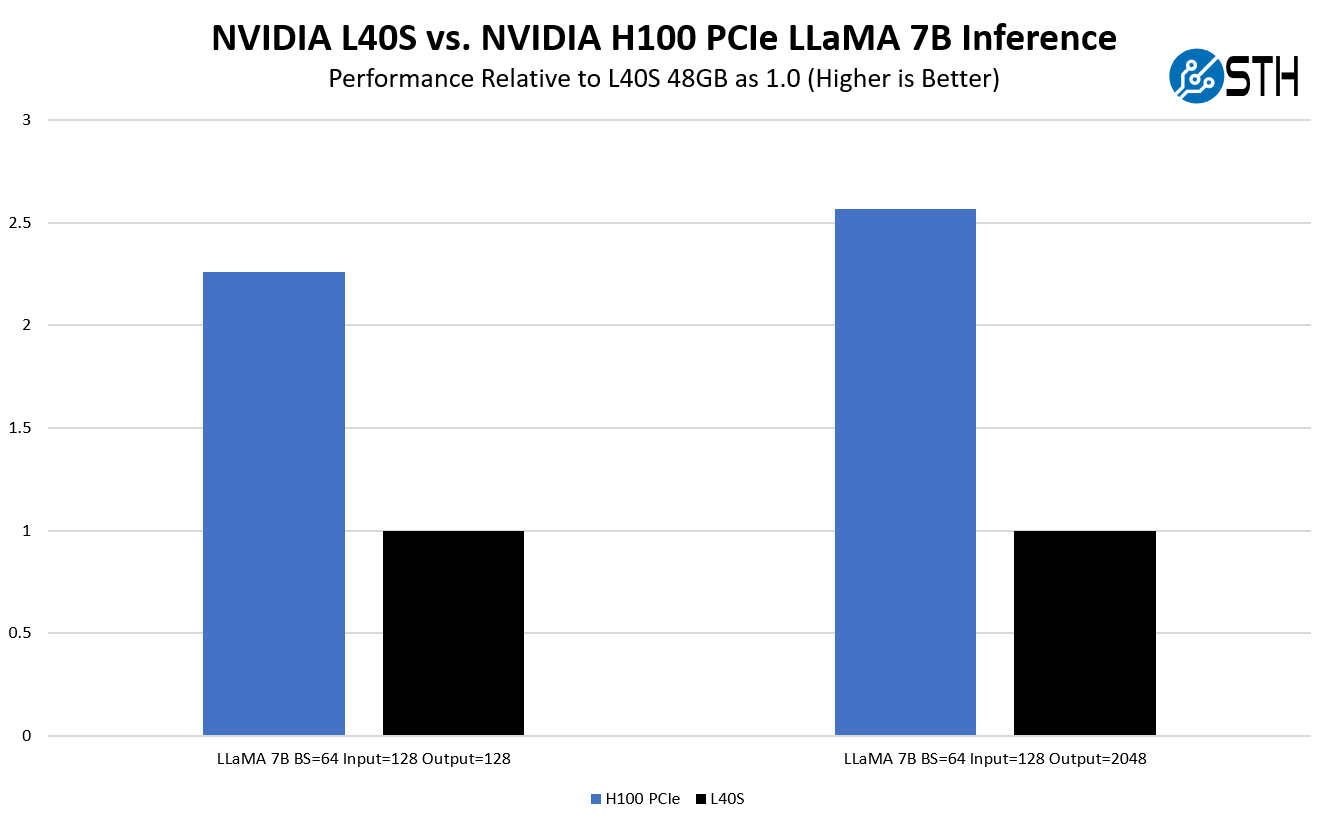

По итогу запустили инференс LLaMA 7B на этих GPU. К сожалению, время доступа к оборудованию было ограничено, что сузило объем тестов. NVIDIA публикует множество данных по производительности в задачах ИИ, поэтому вы можете ознакомиться с ними самостоятельно.

Результаты теста сравнили с официальными данными NVIDIA. В официальных тестах NVIDIA использует версию H100 SXM5, а не PCIe. Версия SXM5 примерно на 25% быстрее (хотя это зависит от нагрузки), так что показатели вполне укладываются в ожидаемый диапазон.

Это подводит к очевидному вопросу: зачем выбирать L40S, если H100 быстрее?

Оказывается, многие выбирают L40S, потому что 48 ГБ памяти (особенно при использовании формата FP8) позволяют этой карте более чем успешно конкурировать с A100 (даже в версии SXM на FP16). С другой стороны, H100 PCIe в 2,0–2,7 раза быстрее, чем L40S, но при этом она и в 2,6 раза дороже.

Здесь есть несколько нюансов. Если вы развертываете более 10 000 графических процессоров, NVIDIA делает ставку не просто на H100, а именно на H100 SXM5 в составе платформ Delta Next с использованием NVSwitch и других сопутствующих технологий.

Другие аспекты сравнения NVIDIA L40S и H100

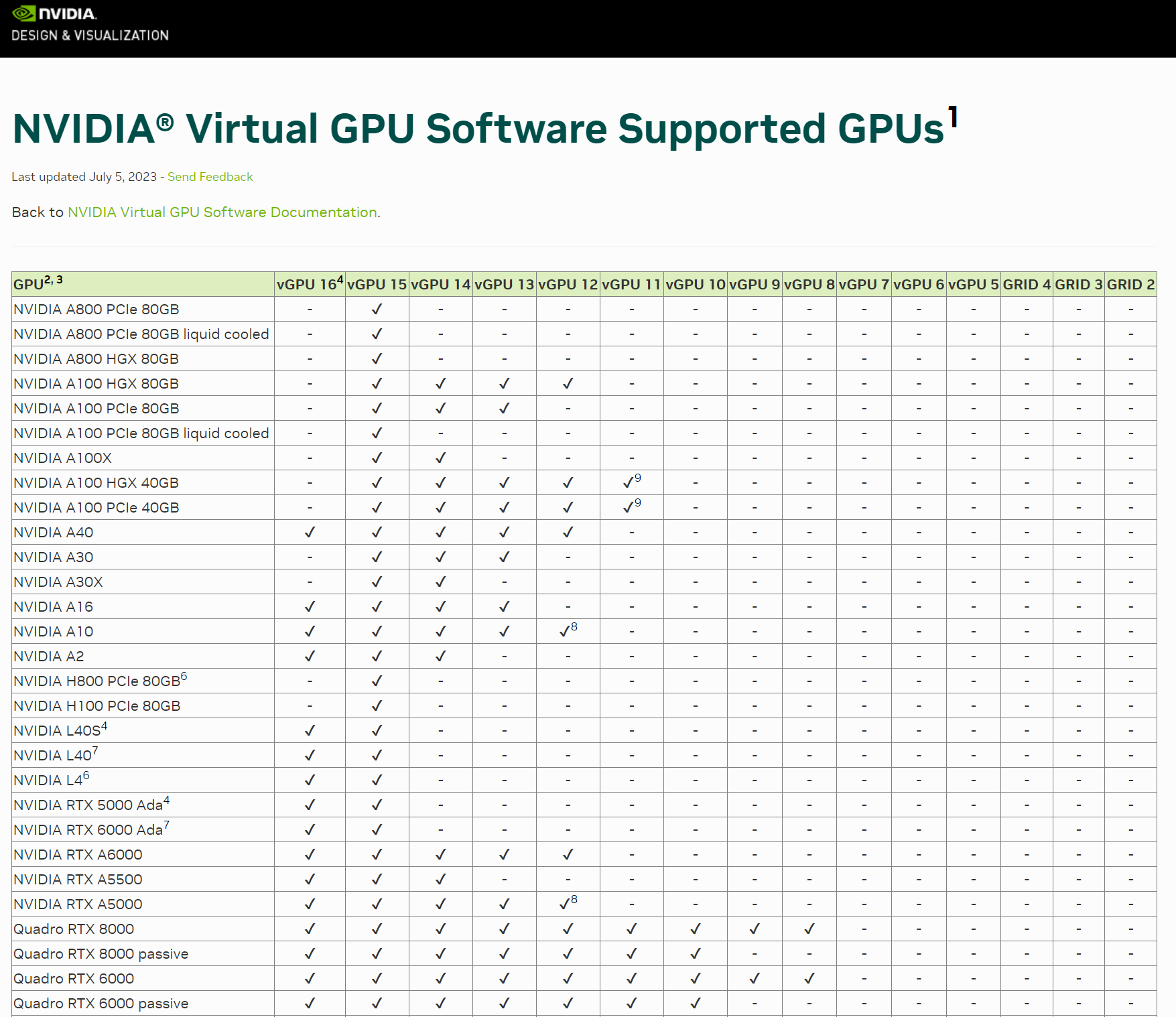

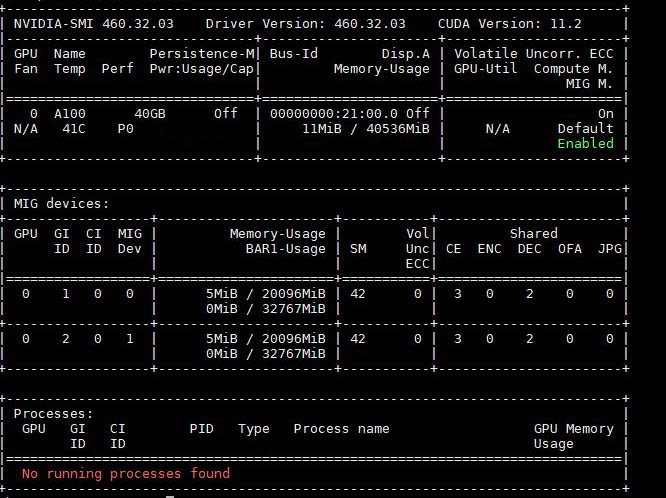

Существует еще несколько аспектов, которые стоит учитывать при выборе L40S. Один из них это поддержка NVIDIA Virtual GPU (vGPU) версии 16.1, в то время как для H100 поддержка все еще ограничена версией vGPU 15. NVIDIA начинает немного разделять свои ИИ-чипы с точки зрения поддержки виртуализации vGPU.

Для тех, кто хочет развернуть один тип серверов и иметь возможность запускать на них самые разные рабочие нагрузки, выбор в пользу L40S выглядит логичным. Учитывая её корни в сегменте визуализации, эта карта оснащена движками кодирования видео с поддержкой AV1 и RT-ядрами.

У L40S есть одна особенность, это то что она не поддерживает MIG (Multi-Instance GPU). MIG - эта технология, которая позволяет разделить одну H100 на 7 изолированных разделов разного размера.

В первую очередь это полезно в публичных облаках, чтобы ресурсы одного графического процессора могли использовать сразу несколько клиентов. Для обычного предприятия (enterprise-сектора) эта функция, как правило, не представляет особого интереса.

Кроме того, развертывание систем на базе L40S требует гораздо меньше энергии, где-то примерно вдвое меньше, чем у систем на базе SXM5. Это делает их очень привлекательными для тех, кто хочет масштабировать свои мощности, но ограничен бюджетом электропитания на каждую стойку.

Подводя итог: L40S уступает H100 в чистой скорости, но благодаря поддержке FP8 и технологии NVIDIA Transformer Engine она становится отличной альтернативой. Для многих заказчиков этот вариант доступнее, проще в развертывании и зачастую обходится дешевле, чем H100.

Вывод

В сети можно встретить много недостоверной информации о сравнении NVIDIA H100 PCIe и L40S, а также о причинах выбора той или иной модели. Надеемся, этот разбор помог прояснить ситуацию.

Главное, что стоит запомнить: L40S не стоит воспринимать просто как «бюджетную замену». Это возвращение к проверенной стратегии: вместо того чтобы гнаться за единичными сверхмощными решениями, эффективнее использовать больше карт среднего уровня. NVIDIA официально поддерживает такую архитектуру, позволяя объединять тысячи L40S в единую систему. Таким образом, выбор в пользу L40S - это ставка на масштабируемость и гибкость инфраструктуры, а не на сиюминутную экономию.

Текст подготовлен на основе материала ServeTheHome. Полный оригинал доступен по ссылке.